Technische Systeme verbessern ohne menschliches Zutun

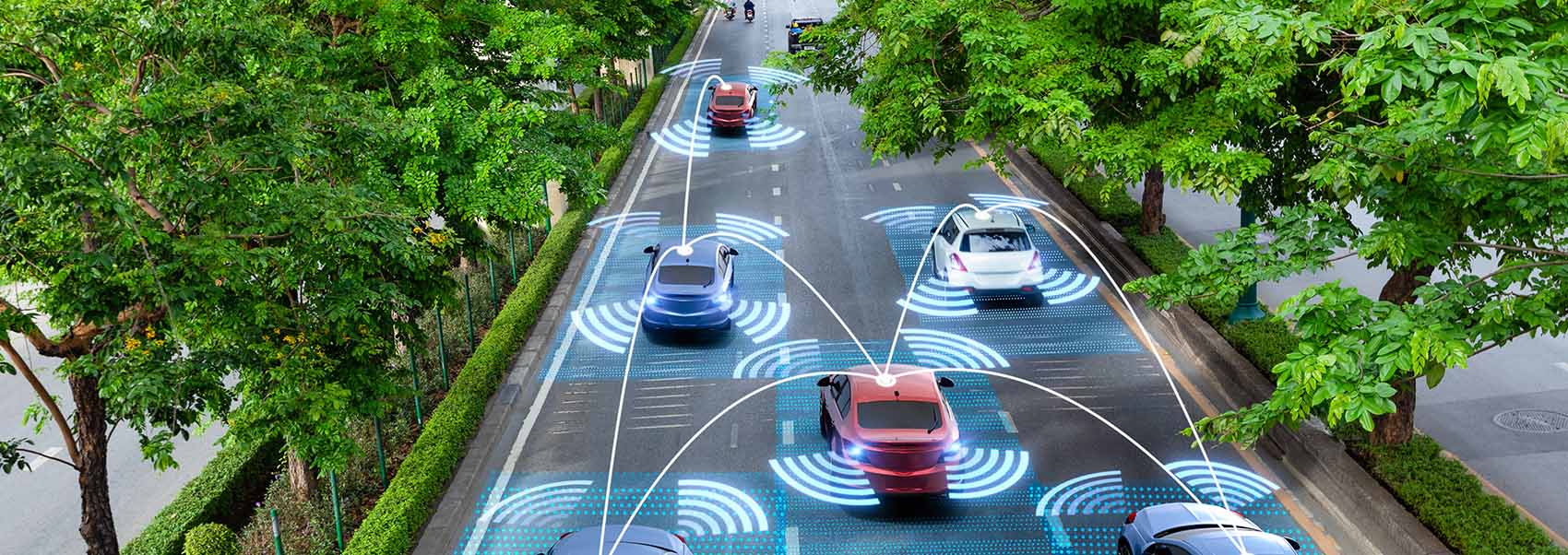

Eine der grundlegenden Voraussetzungen für autonomes Fahren ist die maschinelle Wahrnehmung der Fahrzeugumgebung mittels Kameras und Sensoren. Die dabei generierten Daten werden mittels Künstlicher Intelligenz identifiziert und als Entscheidungsgrundlage interpretiert. Dabei kommt Deep Learning mit zahlreichen Rückkopplungs- und Korrekturschleifen zum Einsatz, wodurch technische Systeme ihre Fähigkeiten ohne menschliches Zutun verbessern und auf dieser Grundlage Entscheidungen treffen können. Dafür müssen sie auf möglichst effiziente Weise trainiert werden. Um dieses Ziel zu erreichen, führt das Fraunhofer IGD zwei Ansätze zusammen: selbst entwickelte Modelle mit synthetisch generierten Trainingsdaten direkt aus dem CAD-System oder modellbasierten Daten eines Simulators mit einer erweiterten Erfassung der “Objekte”, die nicht nur die Bildposition, sondern auch die Verortung in der Umgebung ermöglicht, also die Entfernung und die Blickrichtung des Objektes. Dies erlaubt es z.B. Trajektorien der anderen Verkehrsteilnehmer zu schätzen, um sie für die notwendige Pfadplanung des autonom fahrenden Autos nutzbar machen zu können.

Ereignisbasierte Bildverarbeitungssensoren

Modellbasierte Daten bieten deutliche Vorteile Im Vergleich zum Training mit realen Daten mittels Kameras, da hierbei die benötigten Algorithmen wesentlich schneller entwickelt werden können. Hierzu nutzen die Forschenden der Abteilung VRAR des Fraunhofer IGD Informationen aus ereignisbasierten Bildverarbeitungssensoren, die im Vergleich zu bildbasierten Systemen bis zu 1000-mal weniger Daten erzeugen und somit die Anforderungen an die Datenverarbeitung signifikant verringern. Zudem verbessern Event-basierte Sensoren den Dynamikbereich insbesondere bei extremen Lichtverhältnissen und erfassen sowohl sehr helle als auch sehr dunkle Objekte. Ferner ist ihr Energiebedarf bei hoher Zeitauflösung sehr gering: nur 3 nW pro Ereignis und 26 mW auf Sensorebene, die Zeitauflösung erreicht mehr als 10 000 Einzelbilder (Frames) pro Sekunde.

Fraunhofer-Institut für Graphische Datenverarbeitung IGD

Fraunhofer-Institut für Graphische Datenverarbeitung IGD